هوش مصنوعی با صدای تایپ کردن شما، به دستگاهتان نفوذ میکند

اخبار داغ فناوری اطلاعات و امنیت شبکه

مدل انقلابی هوش مصنوعی ضربات کلید ورودی را از طریق صدا، حدس زده و پیشبینی و تحلیل میکند.

محققان دانشگاه کرنل از یک مدل یادگیری عمیق (Deep Learning) پیشرو و جدید رونمایی کردند که قادر است ورودی صفحه کلید را تنها از سیگنالهای صوتی رمزگشایی کند. این پیشرفت خارقالعاده، به مدیریت جاشوا هریسون، احسان تورینی و مریم مهرنژاد، پیامدهای مهمی برای امنیت دادهها و ظهور حملات سایبری صوتی جدید دارد.

تیم کورنل در مقالهای خود که بهتازگی منتشر شده است، یک مدل هوش مصنوعی (AI) را معرفی کرد که قادر به پیشبینی دقیق ضربات کلید با تجزیهوتحلیل سیگنچرهای صوتی منحصربهفرد تولید شده توسط کلیدهای مختلف روی صفحهکلید است.

این تکنیک شامل آموزش مدل برای مرتبط کردن الگوهای صوتی خاص با کاراکترهای متناظر است و به آن اجازه میدهد تا بهصورت مجازی به تایپ کردن گوش دهد و آن را با دقت شگفتآوری رونویسی و بازنویسی کند.

حملات سایبری سنتی اغلب از آسیبپذیریهای نرمافزاری سواستفاده میکنند یا بر تاکتیکهای فیشینگ تکیه دارند، اما این موج جدید حملات از ویژگیهای فیزیکی صفحهکلیدها استفاده میکند و بر اهمیت صدا بهعنوان یک آسیبپذیری امنیتی بالقوه تاکید میکند. پیامدهای این کشف، بسیار گسترده است، زیرا اینروش میتواند رمز عبور کاربر، مکالمات، پیامها و سایر اطلاعات حساس را به خطر بیاندازد.

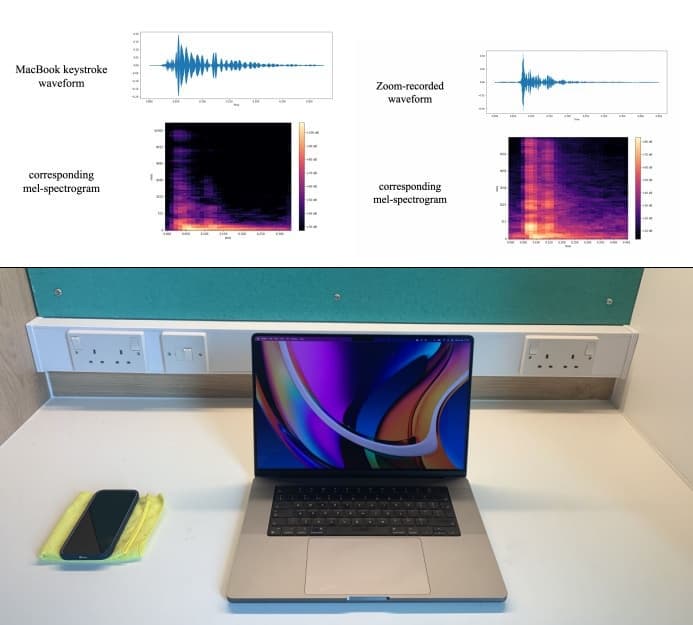

تحقیقات این تیم نشان میدهد که این مدل هنگام آموزش با استفاده از محتوای ضبط شده توسط زوم (Zoom)، به دقت قابل توجه ٩٣ درصد دست مییابد که رکورد جدیدی را برای سیستمهای طبقهبندی مبتنی بر صدا ثبت میکند. فرآیند آموزش مدل شامل قرار دادن آن در معرض چندین نمونه از هر ضربه کلید بر روی یک صفحه کلید خاص است. محققان از MacBook Pro استفاده کردند و هر یک از ٣٦ کلید آن را ٢۵ بار فشار دادند تا یک مجموعه داده جامع برای آموزش ایجاد کنند.

با وجود پتانسیل قابل توجه آن، مدل هوش مصنوعی با محدودیتها و آسیبپذیریهای خاصی همراه است. تغییر سبکهای تایپ یا استفاده از تایپ لمسی میتواند دقت مدل را به میزان قابل توجهی کاهش دهد و آن را به محدوده ٤٠٪ تا ٦٤٪ کاهش دهد. علاوه بر این، اقدامات متقابلی مانند وارد کردن نویز به سیگنال صوتی میتواند ضربات کلید را مبهم کرده و دقت مدل را کاهش دهد.

بااینحال، برای محققان واضح هستند که اثربخشی مدل به مشخصات صدای صفحه کلید خاص بستگی دارد. این وابستگی کاربرد حمله را به صفحه کلیدهایی با ویژگیهای صوتی مشابه محدود میکند و دامنه آن را برای استفاده گسترده مخرب محدود میکند.

با تکامل چشمانداز دیجیتال، رقابت تسلیحاتی بین حملات سایبری و اقدامات دفاعی همچنان در حال افزایش است. توسعه حملات جانبی آکوستیک و صوتی مبتنی بر هوش مصنوعی بر نیاز به اقدامات امنیتی پیشرفته، ازجمله راهحلهای نوآورانه حذف نویز مانند پخش RTX NVIDIA، که میتواند با این نوع حملات مقابله کند، ضروری به نظر میرسند.

برای بررسی جامع یافتهها و روشهای تیم تحقیقانی دانشگاه کورنل، میتوان به مقاله تحقیقاتی رسمی (روی این لینک کلیک کنید) موجود برای مطالعه بیشتر مراجعه کنند. از آنجایی که مرزهای هوش مصنوعی و امنیت سایبری همچنان در حال باریکتر شدن است، درک این پیشرفتها برای افراد و سازمانها ضروری است تا یک گام جلوتر از تهدیدات احتمالی گام بردارند.

برچسب ها: AI Model, acoustic cyberattack, Keystrokes, یادگیری عمیق, Deep Learning, Artificial Intelligence, AI, ZOOM, هوش مصنوعی, Cyber Security, جاسوسی سایبری, امنیت سایبری, جنگ سایبری, Cyber Attacks, مجرمان سایبری, حمله سایبری, news